OpenAI: Foco em IA ou distrações? O alerta de um ex-executivo

Um ex-executivo da OpenAI levanta preocupações sobre o foco da empresa em "missões secundárias", desviando-se da pesquisa em IA Geral (AGI).

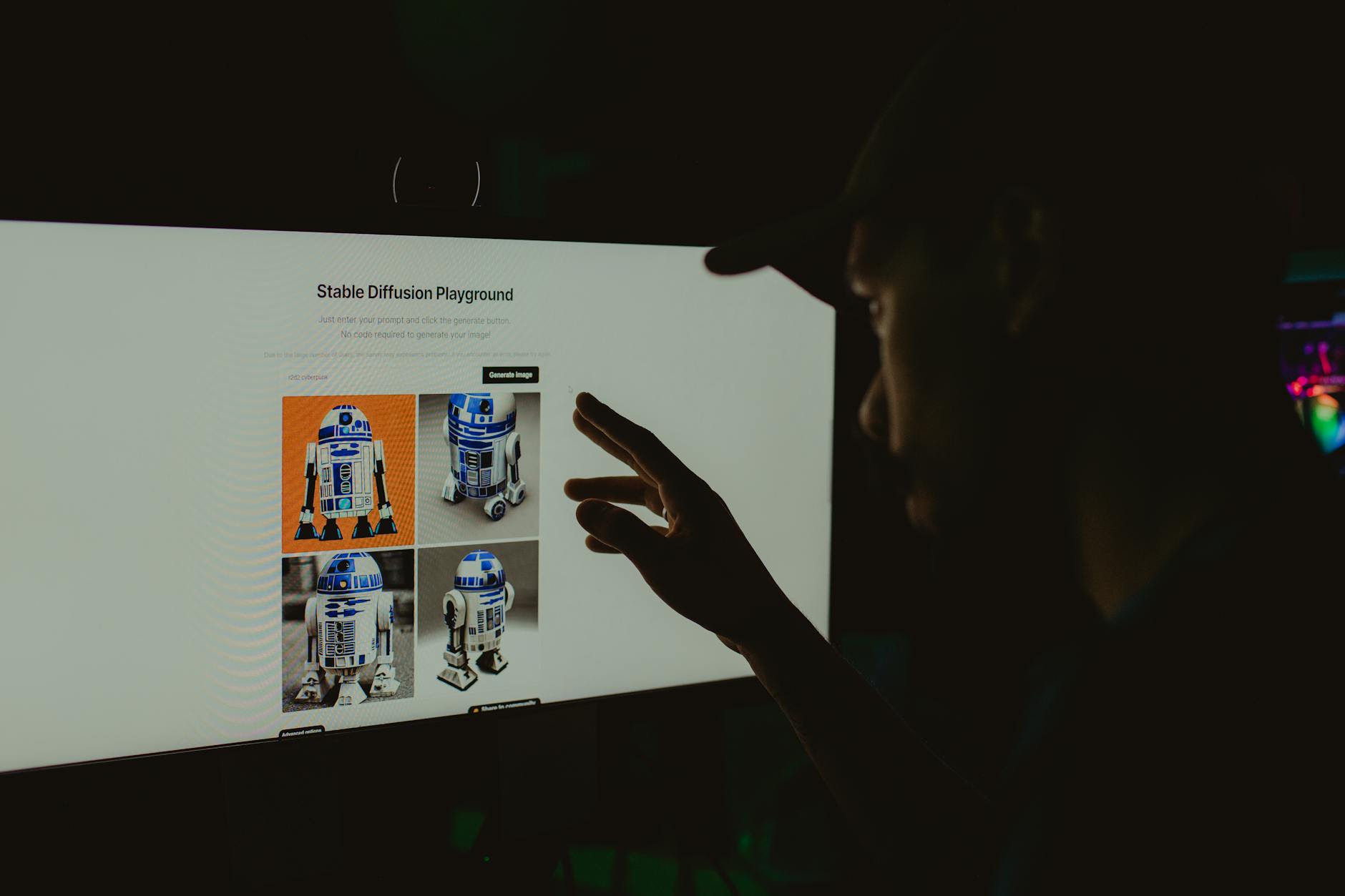

A Inteligência Artificial (IA) avança em ritmo acelerado, prometendo revolucionar a forma como vivemos e trabalhamos. No centro dessa revolução, empresas como a OpenAI se destacam, liderando o desenvolvimento de modelos cada vez mais sofisticados. No entanto, um alerta recente vindo de dentro da própria companhia levanta questionamentos importantes sobre o direcionamento estratégico da OpenAI. Um ex-executivo expressou preocupações de que a empresa possa estar se desviando de sua missão principal, focando em projetos paralelos (“side quests”) em detrimento da pesquisa e desenvolvimento de ponta em IA.

Essa preocupação surge em um momento crucial, onde a IA generativa, como os modelos de linguagem que impulsionam o ChatGPT, está se tornando cada vez mais acessível e integrada em diversas aplicações. A velocidade com que novas funcionalidades e produtos são lançados pode, paradoxalmente, criar um cenário onde a complexidade e o escopo das iniciativas acabam diluindo o foco nos objetivos centrais. A reflexão é: estamos vendo a OpenAI investir seus recursos e talentos nas áreas que realmente impulsionarão o futuro da IA, ou há um risco de dispersão de energia em projetos que, embora interessantes, não contribuem diretamente para a sua missão fundadora?

O Alerta de um Ex-Executivo

O fundador e ex-presidente da OpenAI, Ilya Sutskever, expressou publicamente preocupações sobre o que ele descreveu como "missões secundárias" (“side quests”) da empresa. Sutskever, uma figura proeminente no campo da IA, sugeriu que esses projetos paralelos podem estar desviando a OpenAI de seu objetivo principal de desenvolver uma Inteligência Artificial Geral (AGI) segura e benéfica para toda a humanidade. A AGI é um conceito que se refere a uma IA com a capacidade intelectual de um ser humano, capaz de entender, aprender e aplicar conhecimento em uma ampla gama de tarefas.

A declaração de Sutskever, embora não detalhando quais seriam essas "missões secundárias", aponta para um potencial dilema enfrentado por empresas de tecnologia em rápido crescimento. A pressão para inovar constantemente, atender às demandas do mercado e explorar novas oportunidades pode levar à diversificação de projetos. No entanto, essa diversificação pode vir ao custo de um foco mais estreito e intenso na pesquisa fundamental que é crucial para alcançar marcos significativos em IA, como a AGI.

O Risco da Dispersão

A crítica de Sutskever levanta uma questão fundamental sobre a gestão de recursos e prioridades em empresas de IA de ponta. Quando uma organização se torna muito grande e diversificada, o risco de dispersar seus talentos e capital em múltiplas direções aumenta. A busca por novas linhas de receita, parcerias estratégicas ou até mesmo o desenvolvimento de produtos que não estão diretamente alinhados com a missão central podem, em última análise, retardar o progresso em áreas mais críticas.

Para a OpenAI, cuja missão declarada é garantir que a AGI beneficie toda a humanidade, o foco na segurança, na pesquisa fundamental e na escalabilidade dos modelos é primordial. Projetos que consomem recursos significativos sem contribuir diretamente para esses objetivos podem ser vistos como distrações. A declaração de Sutskever serve como um lembrete de que, mesmo em meio ao sucesso e à expansão, a clareza de propósito e o foco implacável na missão principal são essenciais para alcançar objetivos ambiciosos no campo da IA.

O que isso significa na prática

Na prática, a preocupação expressa por Sutskever pode se traduzir em várias implicações concretas para o desenvolvimento da IA. Se a OpenAI, uma das líderes do setor, estiver realmente desviando seu foco, isso pode significar:

- Menor investimento em pesquisa fundamental de AGI: Projetos paralelos podem consumir tempo e recursos que seriam dedicados a resolver os desafios mais complexos da AGI, como a compreensão contextual profunda, o raciocínio ético e a segurança em larga escala.

- Atraso no desenvolvimento de IA segura: A corrida por novas aplicações e produtos pode levar a um lançamento mais rápido de tecnologias sem a devida atenção aos riscos e à segurança, algo crucial para a AGI.

- Impacto na direção da indústria: Como uma empresa influente, as escolhas estratégicas da OpenAI moldam o caminho de toda a indústria. Se o foco se desviar, outras empresas podem seguir o mesmo padrão, priorizando o lucro de curto prazo em detrimento do desenvolvimento responsável de longo prazo.

- Oportunidades perdidas para a humanidade: O desenvolvimento de uma AGI segura e benéfica tem o potencial de resolver alguns dos maiores desafios globais. Se o progresso for retardado por "missões secundárias", a humanidade pode perder oportunidades valiosas.

Em última análise, a declaração de Sutskever é um chamado à reflexão para todas as organizações que trabalham com IA, especialmente aquelas com ambições de criar tecnologias transformadoras. Manter o foco na missão principal, gerenciar recursos de forma eficaz e priorizar o desenvolvimento responsável são passos cruciais para garantir que a IA avance de maneira segura e benéfica para todos.