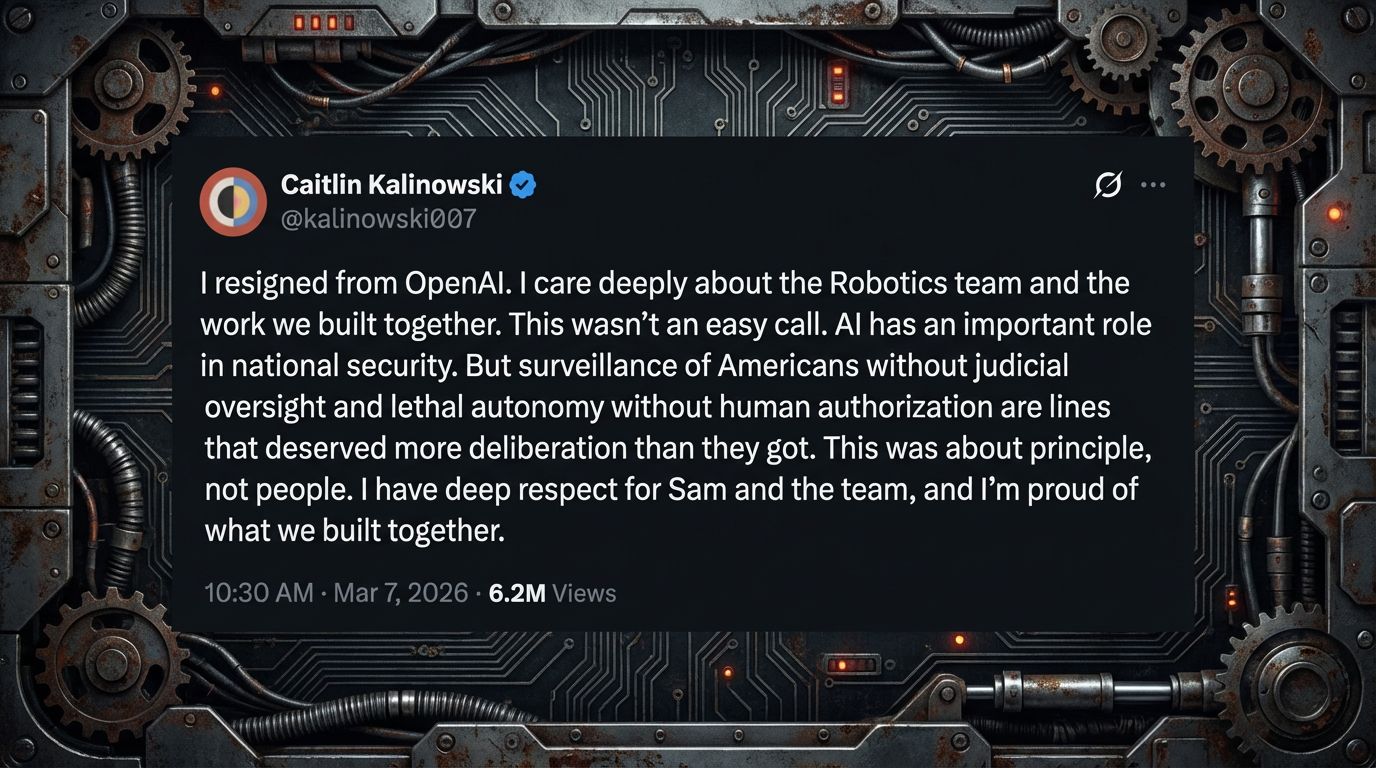

Saída de Líder de Robótica da OpenAI Levanta Questões Sobre Parceria com o Pentágono

A saída do líder de robótica da OpenAI revela tensões éticas sobre o uso da IA em operações militares. O que isso significa para o futuro da tecnologia?

A recente saída do líder de robótica da OpenAI, Jack Clark, provocou uma onda de especulações e discussões na comunidade de inteligência artificial. O motivo? A crescente parceria entre a OpenAI e o Pentágono, que, segundo Clark, não se alinha com sua visão ética sobre a aplicação da inteligência artificial. Este acontecimento não apenas ressalta as tensões entre inovação tecnológica e ética, mas também ilumina os desafios enfrentados por empresas que operam na interseção da tecnologia e da segurança nacional. O que isso significa para o futuro da IA e suas aplicações no setor militar?

A Parceria Polêmica entre OpenAI e o Pentágono

A OpenAI, conhecida por suas inovações em inteligência artificial, está se aventurando em um território delicado ao firmar alianças com o governo dos EUA, especialmente com o Departamento de Defesa. A colaboração visa desenvolver tecnologias que possam ser utilizadas em aplicações militares, o que levanta questões sobre a ética na utilização de IA em situações de combate e vigilância. Clark expressou preocupações sobre como essa tecnologia poderia ser utilizada, defendendo que a IA deve ser um meio para melhorar a vida humana, e não um instrumento de guerra.

Implicações Éticas e Técnicas da IA Militar

A integração da inteligência artificial em operações militares traz à tona um dilema ético. Enquanto a tecnologia pode oferecer vantagens estratégicas, como análise de dados em tempo real e automação de processos, o uso em contextos bélicos pode resultar em consequências desastrosas. O desenvolvimento de algoritmos de decisão autônomos para uso militar é uma área especialmente controversa, pois levanta questões sobre responsabilidade e controle. Até que ponto as máquinas devem tomar decisões que envolvem a vida humana?

O Papel da Comunidade de IA na Discussão Ética

A saída de Clark não é apenas um reflexo de suas crenças pessoais, mas também um chamado à comunidade de inteligência artificial para reconsiderar o papel da tecnologia em cenários militares. Especialistas em IA e ética estão cada vez mais exigindo que as empresas adotem práticas que priorizem a segurança e o bem-estar humano. Isso inclui a implementação de diretrizes rigorosas sobre como a IA deve ser utilizada, especialmente em contextos que podem impactar a vida e a liberdade das pessoas.

O que isso significa na prática

A saída de um líder influente como Jack Clark pode ter repercussões significativas na maneira como as startups e empresas de tecnologia abordam parcerias com entidades governamentais. Para os profissionais de IA e robótica, isso enfatiza a importância de considerar as consequências éticas de suas inovações. Além disso, pode incentivar uma maior transparência nas operações e uma discussão mais ampla sobre os limites do que deve ou não ser desenvolvido. A interação entre tecnologia e ética pode, portanto, moldar as direções futuras da pesquisa e desenvolvimento em IA, influenciando projetos e financiamentos.

Concluindo, a saída de Jack Clark da OpenAI não é apenas uma mudança de pessoal, mas um reflexo das tensões em torno da ética na inteligência artificial. À medida que a tecnologia avança e se torna cada vez mais integrada nas operações militares, a necessidade de um debate ético robusto é mais crucial do que nunca. O futuro da IA deve ser construído sobre bases que priorizem a humanidade, garantindo que a tecnologia seja um meio para promover a paz e a segurança, e não para exacerbar conflitos.