Saída do Líder de Robótica da OpenAI: Um Reflexo das Tensões entre IA e Defesa

A saída do líder de robótica da OpenAI levanta questões éticas sobre a relação entre IA e defesa. Entenda as implicações dessa decisão para o futuro da tecnologia.

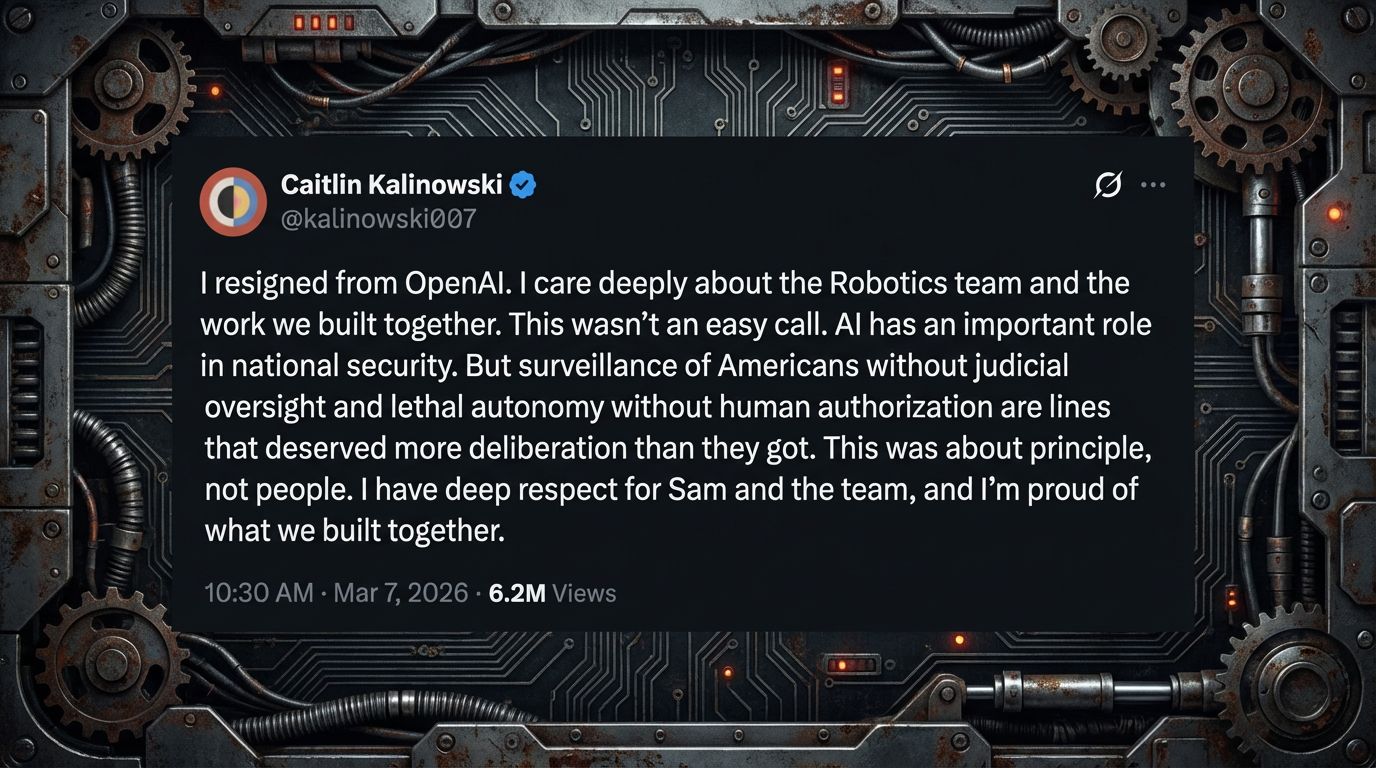

A recente saída do líder de robótica da OpenAI, Jack Clark, gerou um burburinho significativo no setor de inteligência artificial (IA). A decisão dele de deixar a empresa foi impulsionada por um acordo controverso entre a OpenAI e o Departamento de Defesa dos EUA. Essa situação levanta questões importantes sobre a ética no desenvolvimento de tecnologias de IA e sua aplicação em contextos militares. A tensão entre inovação e responsabilidade social está se intensificando, especialmente à medida que as tecnologias avançam rapidamente.

A Conexão entre IA e Defesa

A OpenAI, conhecida por suas inovações em IA, decidiu colaborar com o governo dos EUA, o que, por sua vez, trouxe à tona debates sobre o uso de tecnologias avançadas em conflitos armados. O acordo, que envolve pesquisa e desenvolvimento de robótica, foi considerado por muitos como um passo perigoso, uma vez que pode resultar na militarização da IA. Jack Clark expressou preocupações sobre como essa aliança poderia comprometer a missão original da OpenAI de desenvolver IA de forma segura e benéfica para a humanidade.

Implicações Éticas e Sociais

A saída de Clark não é apenas uma questão de mudança de pessoal, mas reflete um dilema ético mais amplo enfrentado por empresas de tecnologia. A linha entre inovação e ética está se tornando cada vez mais tênue, especialmente quando se trata de aplicações que podem impactar a segurança global. A preocupação é que, sem diretrizes claras, a IA possa ser usada para criar armas autônomas e sistemas de vigilância invasivos, levantando questões sobre privacidade e direitos humanos.

Reações da Comunidade de IA

A comunidade de IA reagiu de forma mista à notícia. Enquanto alguns defendem a colaboração com o governo como uma forma de garantir que a tecnologia seja utilizada para a segurança nacional, outros alertam sobre os perigos da militarização da IA. O consenso parece ser que, embora a inovação seja vital, ela deve ser guiada por princípios éticos que priorizem a segurança e o bem-estar da sociedade.

O que isso significa na prática

Na prática, a saída de Jack Clark pode sinalizar uma mudança na forma como as empresas de IA abordam parcerias com o setor militar. Isso pode levar a um aumento na demanda por transparência e responsabilidade no desenvolvimento de tecnologias. Além disso, pode impulsionar outras empresas a reconsiderar suas colaborações e a adotar práticas mais éticas em seus projetos. Essa situação pode também inspirar a criação de diretrizes e regulamentações mais rigorosas sobre o uso de IA em contextos militares, promovendo um debate mais amplo sobre a responsabilidade das empresas tecnológicas.

A IA deve ser desenvolvida com um compromisso claro com a ética e a segurança, especialmente quando suas aplicações podem impactar a vida humana.

Em conclusão, a saída de Jack Clark da OpenAI é um sinal claro de que as tensões entre inovação e ética na IA estão crescendo. À medida que a tecnologia avança, será crucial que as empresas e desenvolvedores se unam para estabelecer diretrizes que garantam que a IA seja utilizada para o bem comum, evitando assim um futuro onde a tecnologia se torna uma ferramenta de opressão e conflito. O futuro da IA depende de escolhas conscientes e responsáveis, que priorizem a humanidade acima de tudo.